2020 年,微软与 OpenAI 达成了协议,微软将拥有对 GPT-3 源代码的独家访问权,自此 OpenAI 就不像以往一样开放其 GPT-3 AI 模型,而 OpenAI 的 GPT-1 和 GPT-2 仍然是开源项目。

为了打破 OpenAI 和微软对自然语言处理 AI 模型的垄断,Connor Leahy、Leo Gao 和 Sid Black 创立了 EleutherAI,这是一个专注于人工智能对齐、扩展和开源人工智能研究的组织。近日 EleutherAI 研究团队开源了一个基于 GPT-3 的自然语言处理 AI 模型 GPT-J。

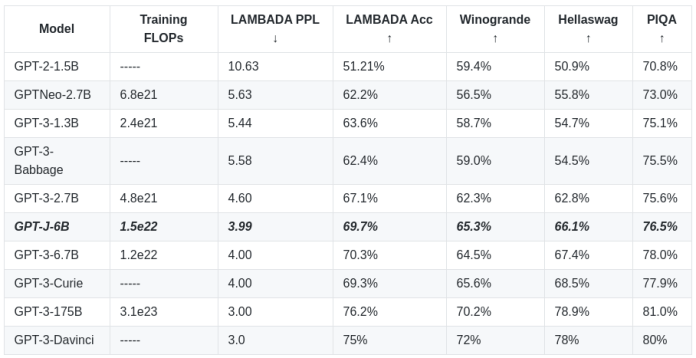

GPT-J 是一个基于 GPT-3,由 60 亿个参数组成的自然语言处理 AI 模型。该模型在一个 800GB 的开源文本数据集上进行训练,并且能够与类似规模的 GPT-3 模型相媲美。

该模型通过利用 Google Cloud 的 v3-256 TPU 以及 EleutherAI 的 The Pile 数据集进行训练的,历时大约五周时间。GPT-J 在标准 NLP 基准工作负载上实现了与 OpenAI 报告的 67 亿参数版本的 GPT-3 类似的准确性。模型代码、预训练的权重文件、Colab 文档和一个演示网页都包含在 EleutherAI 的开源项目中。

EleutherAI 在 2021 年 3 月发布了 27 亿参数的 GPT-Neo 模型,这是他们对类 GPT 系统的第一个实现。GPT-Neo 是在 TensorFlow 中构建的,并通过 Mesh TensorFlow 并行库在 TPU 上训练。该团队目前还正在开发 GPT-NeoX,这是一个基于微软 DeepSpeed 的 GPU 解决方案;虽然代码是开源的,但目前没有模型文件可以访问。

最新的模型 GPT-J 是用 Mesh-Transformer-JAX 这个新库来训练的。该库没有使用像 TensorFlow 这样的特定深度学习框架,而是使用 Google 的 JAX 线性代数框架。GPT-J 提供了比 Tensorflow 更灵活、更快速的推理,该模型的开发时间远远少于早期的举措。与 GPT-Neo 模型相比,GPT-J 的训练效率提高了 125%。在几个 Down-Streaming 工作负载的零点性能方面,GPT-J 是公开的 Transformer LM 中表现最好的。

EleutherAI 的开发者 Komatsuzaki 表示:“与 TensorFlow 和 TPU 的同类产品相比,它允许更灵活、更快速的推理。更重要的是,该项目需要的时间大大少于其他大规模模型。研究表明,JAX + xmap + TPU 是快速大规模模型开发的完美 工具 集合。”

开发者可以在 GitHub 上找到 GPT-J 的源代码和模型,并能在 EleutherAI 的官方网站上找到互动演示。

猜你喜欢: