导语

Lichee是一个多模态内容理解算法框架项目,其中包含数据增强、预训练引擎、常见模型以及推理加速等模块。由腾讯看点内容算法研发中心研发。并于2021年在腾讯看点、腾讯视频、内容管线、QQ等业务场景均有落地,并平均减少标注样本量40%+。经过多次实践迭代,可以大幅缩短信息流内容理解需求的研发周期提升人效。此外,为QQ浏览器2021AI算法大赛-多模态视频相似度赛道提供baseline模型及代码。现将Lichee对外开源,为微服务开源社区贡献力量。

主要设计目标

1. 缩短信息流内容理解需求的研发周期

2. 集成AI领域的成熟解决方案

Lichee功能介绍以及适用场景

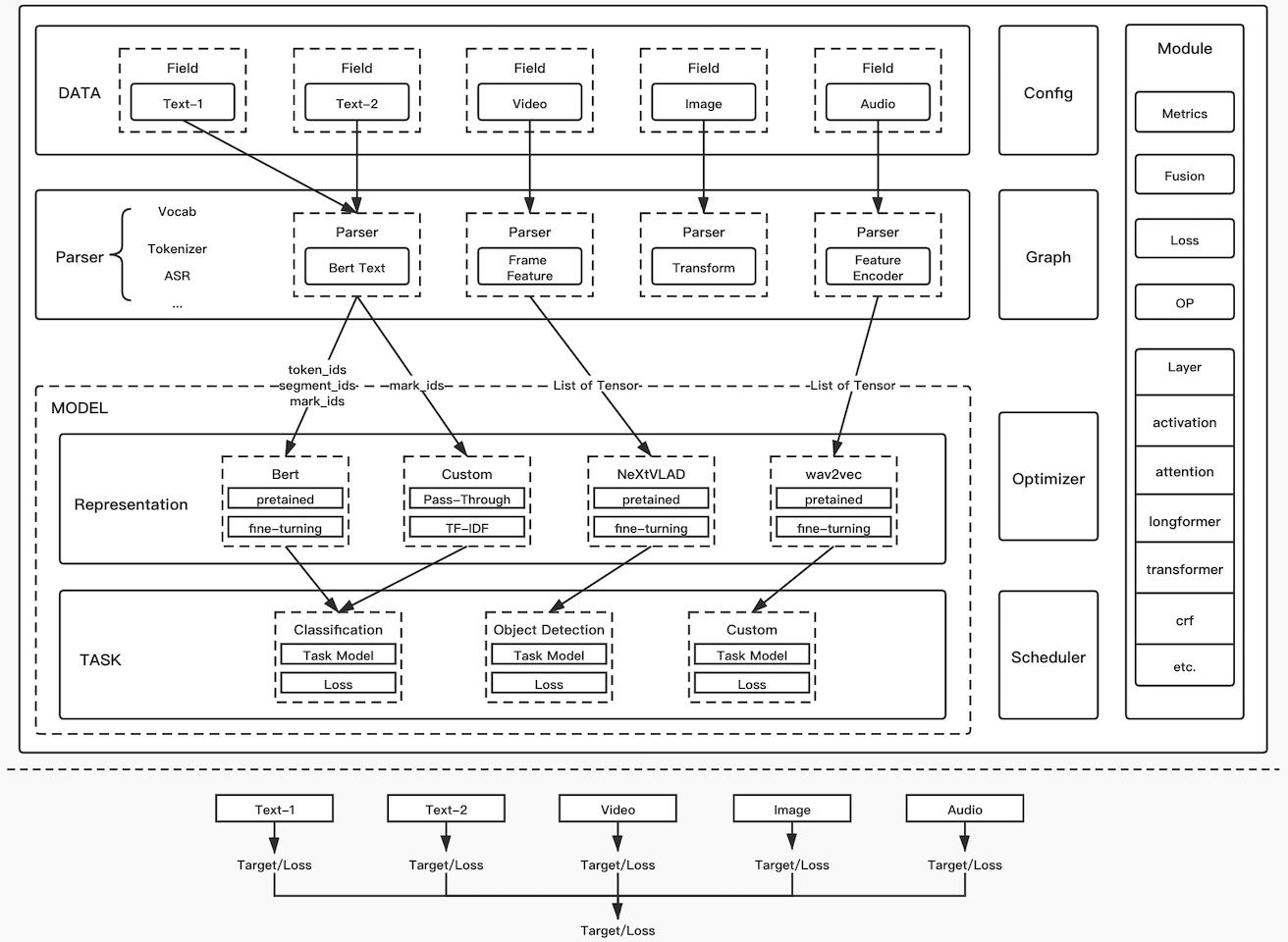

Lichee主框架采用分层的思想组织模型训练,通过配置文件组合 DATA、Parser、MODEL、Optimizer、Scheduler 等组件,构建具体的训练流程。此外,Lichee还提供了数据清理、推理加速等能力。

Lichee技术特点:

1. 性能优越的预训练引擎

提供了自研中文预训练模型,如LICHEE-NLG-ENGINE、LICHEE-RESNET-ENGINE等,免除训练中文预训练模型必须的大量资源和高质量语料库的限制。LICHEE/ShenZhou预训练模型先后于2021年1月8号和2021年9月19号登顶中文NLP权威榜单CLUE。相关技术创新在NLP顶会ACL 2021发表文章(https://arxiv.org/pdf/2108.00801.pdf)。

2. 基于配置化的模型训练

满足90%+业务场景仅通过配置即可完成模型训练任务。

3. 提供二次开发能力

提供了基于插件的二次开发能力,来满足更复杂的特殊业务场景。

4. 数据增强

为了进一步降低任务样本的数量,提供了数据增强插件,解决脏数据清洗和数据生成等方面的工作。

5. 能力插件

提供了更多的结构化能力插件,如词法分析工具LICHEE-LAC、句子相似度工具LICHEE-SIM、人脸识别工具LICHEE-Face等。

6. 推理加速

集成推理加速的能力,能够降低业务模型的实际部署成本。

Lichee项目规划

1. 扩充各领域的预训练模型

2. 扩充训练加速、推理加速能力

3. 兼容hugging face项目

4. 提升项目的易用性、开放性及效率

Lichee开源地址

https://github.com/Tencent/Lichee

猜你喜欢: